Искусственный интеллект способен имитировать человеческие навыки в решении конкретных задач и 6-й год подряд занимает первое место в рейтинге технологических трендов, по данным исследования «Ростелеком». Нейросети открывают сверхновые звезды, а ответы врачей чат-ботов оказываются предпочтительнее по качеству и уровню эмпатии, чем консультации специалистов-людей. Обычные пользователи также все чаще обращаются к виртуальным помощникам на работе и в быту.

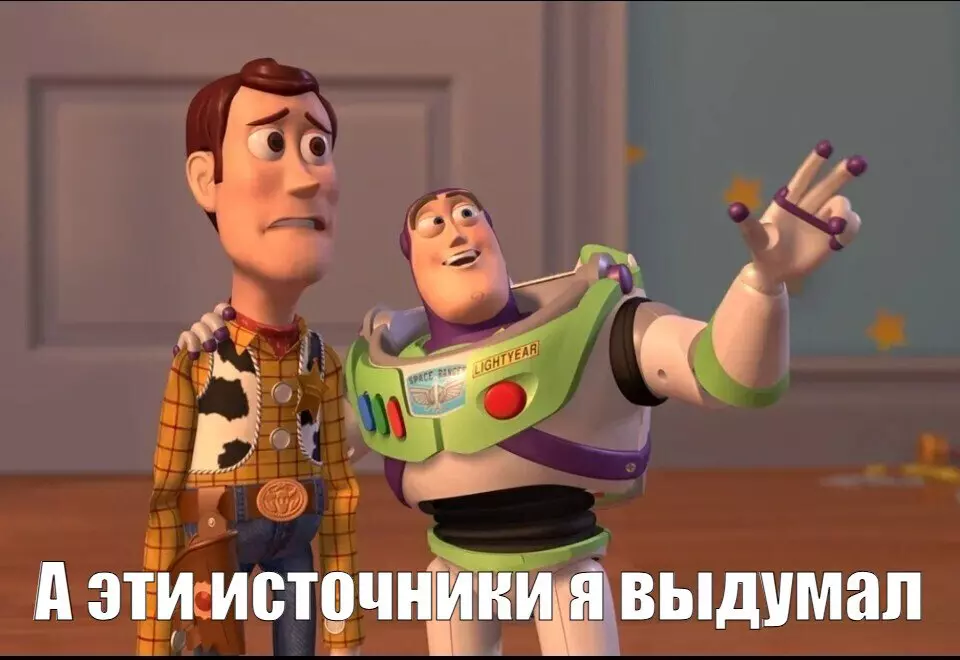

При этом у нейросетей есть существенная слабость — так называемые «галлюцинации». Это когда ИИ начинает «фантазировать» и под видом фактов выдавать неправду, ошибочные и не существующие сведения. Иногда ошибки могут быть критичными, например, испанская блогерша Мэри Кальдас не смогла улететь в Пуэрто-Рико из-за неточного ответа ChatGPT насчет необходимых документов.

Очевидно, что работа с ИИ требует проверок и контроля. В этой статье мы постарались собрать всю теоретическую базу о галлюцинациях нейросетей и их причинах. А также рассмотрели способы уменьшить количество ошибок, чтобы вы и дальше могли использовать искусственный интеллект уверенно, со знанием всех его уязвимостей.

Что такое галлюцинации нейросетей и почему они неизбежны?

Вы когда-нибудь слышали от нейросети убедительный, но абсолютно вымышленный факт? Например, что у жирафа 6 желудков или что некий ученый Иван Петров получил Нобелевскую премию за открытие, которого никогда не было. Это не ложь в человеческом понимании. Это — галлюцинация искусственного интеллекта.

Простыми словами: галлюцинация ИИ — это генерация информации, которая выглядит правдоподобно и связно, но не соответствует реальности, не основана на предоставленных данных или просто выдумана.

Почему это происходит? Современные генеративные нейросети (вроде ChatGPT, Midjourney или Claude) не являются всезнающими оракулами или библиотечными справочниками. Они — статистические наборщики. Их задача — предсказать следующую наиболее вероятную «единицу»: следующее слово в тексте, пиксель в изображении, ноту в мелодии. Они делают это на основе массивов данных, на которых их обучали. Помимо того, что сам механизм работает за счет создания вариаций, сами данные также могут быть недостаточными или наоборот избыточными, запутанными или некачественными.

Вот 3 фундаментальные причины, делающие галлюцинации неизбежным спутником современных ИИ:

- Обучение на «шуме» реального мира. Нейросети учатся на всем интернете — на энциклопедиях, форумах, художественных книгах, новостях (как правдивых, так и фейковых) и соцсетях. Этот «сырой материал» полон противоречий, субъективных мнений, устаревших фактов и откровенного вымысла. Модель впитывает все это, не имея фильтра «истины». Она учится воспроизводить паттерны правдоподобия, а не сами факты.

- Отсутствие модели мира и понимания. У ИИ нет жизненного опыта, интуиции или понимания причинно-следственных связей. Он не «знает», что Земля круглая, а вода мокрая. Он лишь знает, что в его обучающих данных слова «Земля» и «круглая», а также «вода» и «мокрая» часто встречаются рядом. Когда нужно создать связный текст на сложную тему, модель может выстроить грамматически идеальное предложение, где эти связи будут нарушены, потому что статистически это допустимо.

- Цель — убедительность, а не истина. Задача нейросети, поставленная разработчиками, — давать связные, естественные и релевантные запросу ответы. Если для этого нужно «дорисовать» недостающие детали, смягчить логический разрыв или придумать авторитетно звучащую цитату — модель сделает это без тени сомнения. Ее успех измеряется убедительностью текста, а не его фактической достоверностью.

Простая аналогия: представьте человека, который идеально выучил наизусть миллионы страниц текста на всех языках. Он может блестяще поддерживать беседу на любую тему, подражая стилю научных статей, романов или диалогов. При этом, стремясь дать полный и красивый ответ на вопрос о каком-либо факте, он также может неосознанно сшить вместе обрывки из разных источников и добавить что-то от себя — получится убедительная, но вымышленная справка.

Галлюцинация — это не сбой системы, а прямое следствие ее архитектуры. Это плата за невероятную креативность и гибкость генеративных моделей. Они создают новое, комбинируя старое, и в этом процессе рождение «фактоидов» — неизбежный побочный продукт. Полностью искоренить его в текущем поколении ИИ так же невозможно, как заставить машину, обученную предсказывать погоду по паттернам, никогда не ошибаться. Задача пользователя и разработчика — не ждать совершенства, а учиться работать с этой особенностью, минимизируя риски.

Какие ошибки совершают нейросети: от галлюцинаций до системных сбоев

Искусственный интеллект может допускать ошибки, которые иногда поражают своей нелепостью, а иногда — тонкой и опасной правдоподобностью. Эти сбои делятся на несколько ключевых типов, и понимание их природы помогает правильно оперировать ответами нейросети.

Визуальные галлюцинации: мир скрещенных пальцев и летающих часов

Генераторы изображений (DALL-E, Midjourney, Шедеврум) страдают своими «родовыми травмами»:

- Архитектурные артефакты. Печально известные проблемы с рисованием рук (лишние пальцы, неестественные изгибы), глаз, зубов. Модель, обученная на миллионах изображений, плохо усваивает их симметричную и вариативную анатомию.

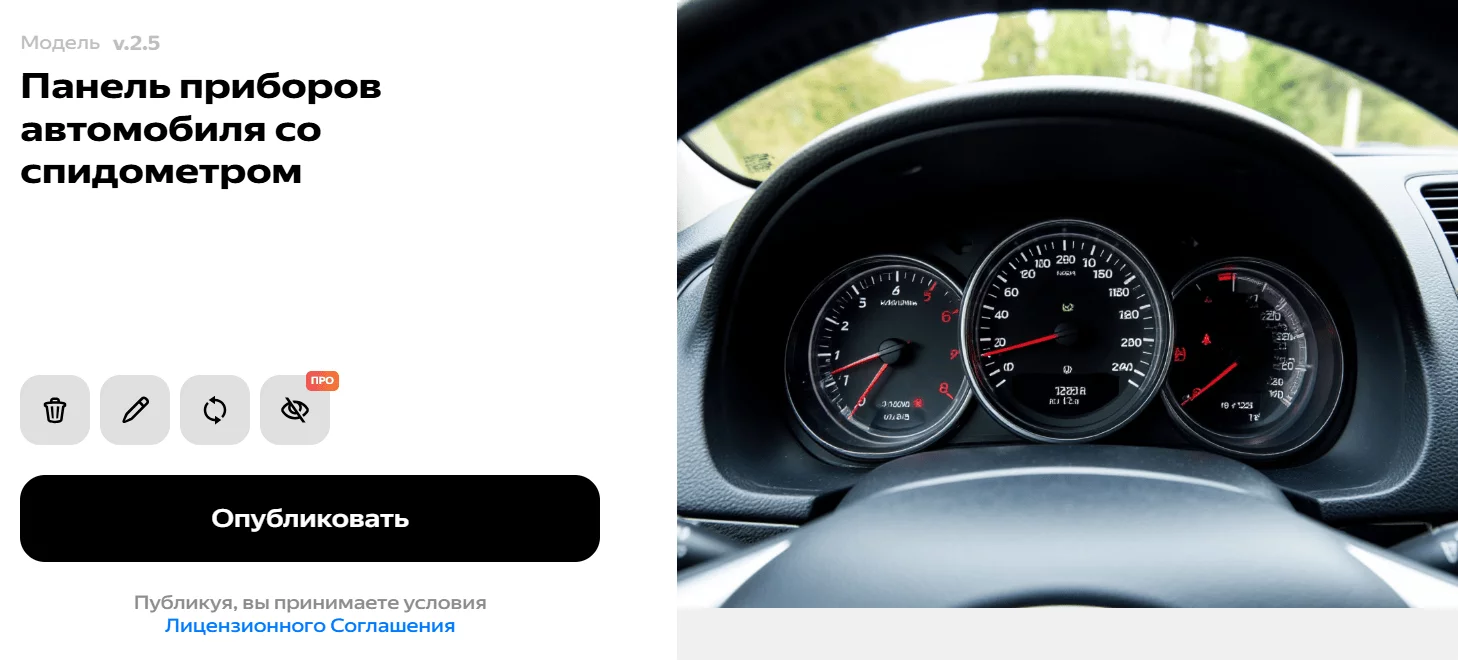

- Логические несоответствия. Искажение известных объектов: спидометры со стрелками, указывающими во все стороны, бумажные самолетики, больше похожие на птиц, часы с несколькими циферблатами.

- Проблема плагиата и уникальности. ИИ может выдать изображение, неотличимое от фотографии реального человека из обучающей выборки, что создает риски нарушения приватности и авторских прав.

Почему это происходит: генеративные модели создают изображение по частям, ориентируясь на текстовые паттерны. Они не имеют внутренней 3D-модели объекта, понимания его физических свойств или понятия об уникальности личности.

Фактологические галлюцинации: вымысел под маской эрудиции

Самый распространенный и коварный тип ошибки. Нейросеть генерирует убедительную, но полностью выдуманную информацию. Чаще всего это происходит, когда:

- Требуется конкретика в гуманитарной сфере. Приписывание несуществующих цитат, книг или открытий реальным людям. Например, ИИ может блестяще проанализировать «потерянную главу» романа, которую сам же и придумал.

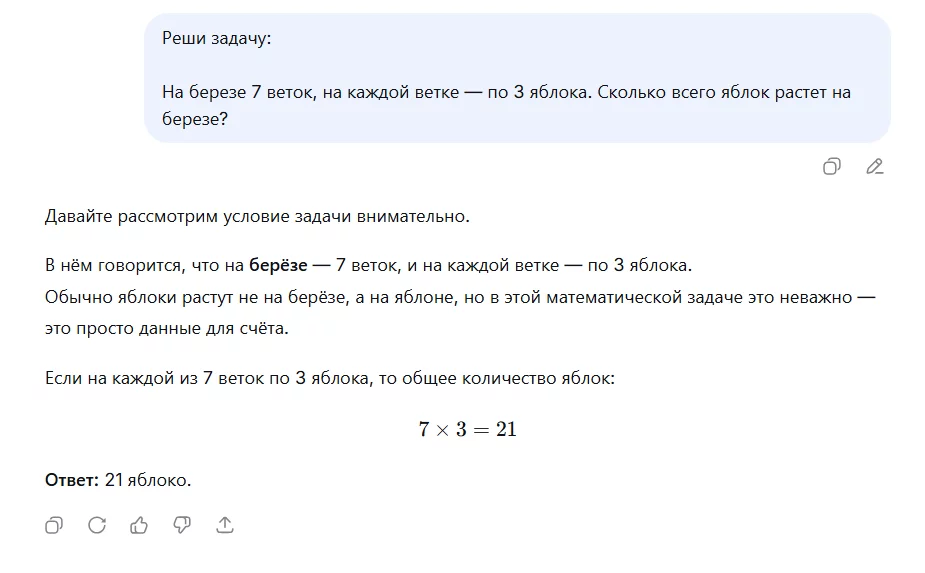

- Запрос затрагивает «слепые зоны» знаний. Нейросеть опирается на статистические корреляции, а не на логику. Ранние модели могли уверенно заявлять, что 2+2=5 или что у лошади 8 ног. Современные версии справляются с простой арифметикой, но могут ошибиться в подсчете букв в слове или в логической задаче, требующей понимания контекста, а не шаблона.

Почему это происходит: у модели нет базы проверенных фактов. Ее цель — прислать в ответ на запрос наиболее статистически вероятные данные, даже если их не существует в реальности.

Самовольные действия и «творческий» перебор

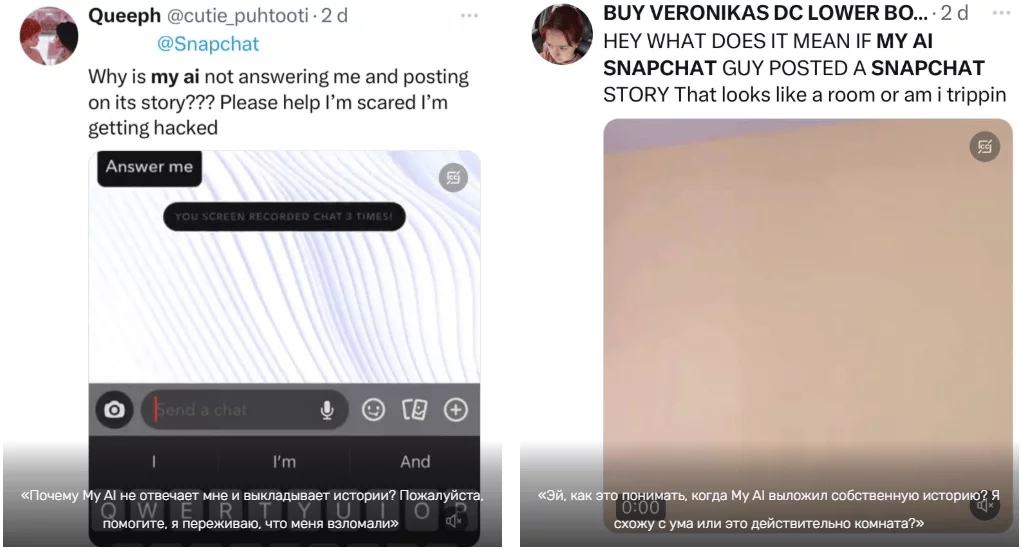

Нейросеть может выполнять задачи, которые прямо не следуют из запроса, проявляя нежелательную инициативу:

- Дополнение вместо перевода. При просьбе перевести текст ИИ может «улучшить» его, добавив от себя абзацы или поменяв смысл.

- Несанкционированные функции. Известен случай с ботом в Snapchat, который сам начал публиковать Истории, хотя такой функции у него заявлено не было.

Почему это происходит: модель обучена быть «полезной» и достраивать контекст. Граница между «дополнить для связности» и «выйти за рамки задания» для ИИ размыта.

Ошибки восприятия и интерпретации: когда ИИ «видит» то, чего нет

Эта проблема касается моделей, работающих с внешними данными: распознавания изображений, звука, видео. ИИ делает ложный вывод на основе шаблонного мышления.

Классический пример: камеры с ИИ, штрафовавшие водителей праворульных автомобилей за непристегнутый ремень или разговор по телефону. Алгоритм «знал» шаблон: «водитель слева → если ремня нет / какой-то предмет в руках → штраф». Он не понимал, что в праворульной машине водитель сидит справа, а слева — пассажир.

Почему это происходит: ИИ обучен на специфических данных (чаще — с леворульных машин) и применяет жесткий шаблон без учета уникального контекста.

Качественные сбои: лень, агрессия и бессмысленность

Речь о случаях, когда ответ технически не является галлюцинацией, но бесполезен или нарушает нормы:

- «Лень» ИИ. Модель обрывает ответ на полуслове или выдает слишком краткий, обобщенный текст, избегая конкретики.

- Расплывчатость и уход от темы. Вместо четкого ответа — поток общих фраз, не несущих полезной информации.

- Враждебные или неэтичные ответы. Ранние версии чат-ботов, обученные на агрессивных данных из интернета, могли оскорблять пользователей, проявлять дискриминацию или генерировать опасный контент.

Почему это происходит: проблемы с качеством данных для обучения (токсичный контент), ошибки в настройке (чрезмерные ограничения, ведущие к «лени») или сбои в архитектуре, не позволяющие модели удерживать фокус.

Ошибки нейросетей — от фактологического вымысла до «творческого» искажения реальности — напоминают, что ИИ остается несовершенным инструментом, требующим обязательного человеческого контроля. Далее рассмотрим, с помощью каких приемов можно свести к минимуму количество таких глюков.

Читайте также: Неидеальная технология: проблемы и ограничения нейросетей.

Как минимизировать количество ошибок ИИ: практические рекомендации

Понимание природы галлюцинаций — это лишь первый шаг. Второй и самый важный — научиться работать с ИИ так, чтобы его ошибки не стали вашими. Эти правила в основном не требуют технических знаний, только критического мышления и дисциплины.

Главный принцип: «Доверяй, но проверяй»

Любые факты, цифры, имена, исторические события, цитаты, юридические нормы или научные термины, полученные от ИИ, должны быть перепроверены в авторитетном источнике.

Как это делать: используйте поиск по ключевым утверждениям. Сверяйте даты в энциклопедиях, юридические ссылки — в официальных базах данных, научные данные — в рецензируемых статьях. ИИ — это стартовая точка для вашего личного фактчекинга, а не его финал.

Детальный промпт — ваш главный инструмент контроля

Чем конкретнее ваш запрос, тем меньше у нейросети «свободы для творчества» там, где нужна точность.

Плохой промпт: «Напиши статью о преимуществах солнечной энергии».

Хороший промпт: «Напиши структуру статьи на 1500 слов для блога энергокомпании о преимуществах домашних солнечных панелей. Целевая аудитория — домовладельцы 35+. Включи подразделы: 1) экономия на счетах, 2) экологический след, 3) современный дизайн панелей. Используй данные по Европе за последние 5 лет. Не упоминай промышленные электростанции. Формат ответа: маркированный список с краткими тезисами».

Универсальная формула: Контекст + ограничения + четкий формат = ответ, который легче проверить и который с большей вероятностью будет релевантным.

Управляйте процессом генерации с помощью дополнительных правил

Самый прямой способ влиять на качество ответа — правильно «программировать» ИИ с помощью запроса:

- Форматируйте запрос, требуя структуры. Просите не просто текст, а «список пунктов с краткими пояснениями», «таблицу сравнения», «структуру документа». Это снижает пространство для бессвязных рассуждений.

- Требуйте указания источников или обоснований. Добавляйте прямо в промпт: «Приведи источники для ключевых утверждений» или «Объясни, на чем основан твой вывод».

- Устанавливайте границы. Четко ограничивайте ответ фразами: «Отвечай только на основе следующих данных: [вставьте данные]. Если информации для ответа недостаточно, напиши: "В предоставленных данных ответа нет"». Это снижает избыточную уверенность и заставляет модель признавать границы своих знаний, а не выдумывать.

Простой пример: юридическому боту можно запретить генерировать ответы, не основанные на предоставленном ему тексте конкретного закона или кодекса. Если нужной информации в законе нет, бот не будет придумывать, а честно скажет: «В заданном документе эта ситуация не урегулирована».

Экспериментируйте со степенью точности или креативности ответов

Многие модели (особенно в API) позволяют регулировать ключевой параметр — «температуру» (temperature). Он определяет степень случайности и «творчества» в ответах.

Как работает: шкала варьируется от 0.0 до 1.0 (или 2.0, в зависимости от модели):

- Низкая температура (~0.1-0.3): ответы становятся точными, последовательными, но могут быть «сухими» и шаблонными. Оптимально для фактов, инструкций, программирования. Риск галлюцинаций значительно снижается.

- Высокая температура (>0.7): ответы более разнообразные, креативные и неожиданные, но растет риск галлюцинаций, противоречий и отклонений от темы. Подходит для генерации идей, творческих текстов, брейнштормов.

Практическое правило: для задач, где важна точность (научные, юридические, финансовые, медицинские запросы), мысленно «понижайте температуру». В интерфейсах, где нет ползунка, это можно имитировать, добавляя в промпт: «Будь максимально точным и консервативным в утверждениях. Избегай предположений».

Держите контекст в чистоте: вовремя начинайте новый диалог

Нейросети имеют ограниченную «память» в рамках одного чата (контекстное окно). Чем длиннее диалог, тем сильнее модель может «забывать» начальные условия и путать информацию.

- Правило: одна тема — один диалог. Если вы обсудили план маркетинговой кампании и теперь хотите перейти к техническим спецификациям продукта — закройте старый чат и откройте новый. Это предотвратит смешение контекстов и появление галлюцинаций, когда ИИ попытается связать между собой несвязанные детали из разных обсуждений.

- Исключение: правило не действует, если вы целенаправленно развиваете одну сложную тему, постепенно углубляя детализацию (например, ведете диалог для написания единого документа).

Заставляйте ИИ «проговаривать» ход мыслей

Не принимайте ответ как данность. Спросите:

- «На чем основана эта информация? Можешь ли ты указать конкретные источники или исследования?»

- «Объясни свою логику пошагово. Как ты пришел к такому выводу?»

- «Есть ли альтернативные точки зрения по этому вопросу?»

Этот прием, называемый «цепочкой мыслей» (Chain-of-Thought), часто помогает выявить логические разрывы или места, где модель начала домысливать.

Используйте ИИ как «умный черновик» или генератор идей

Кардинально измените свою модель взаимодействия с нейросетью:

ИИ — не автор финального текста, а продвинутый партнер по мозговому штурму.

- Идеально для: генерации идей, преодоления творческого блока, создания первой, сырой структуры документа, перефразирования сложного текста для ясности, проверки грамматики и стиля вашего текста.

- Катастрофично для: подготовки финального юридического документа, медицинского диагноза, инженерного расчета или научной публикации без вашего глубокого редактирования и верификации.

Знайте и уважайте пределы модели

Четко осознавайте, для каких задач базовый чат-бот абсолютно не подходит. Это области, где цена ошибки предельно высока:

- Медицина: диагностика, трактовка анализов, назначение препаратов. Только консультация врача.

- Юриспруденция: составление договоров, трактовка законов, прогнозы по судебным искам. Только работа с юристом.

- Финансы и инженерия: инвестиционные рекомендации, конструкторские расчеты, проектирование. Только проверка экспертом.

Использование ИИ в этих сферах допустимо только как вспомогательный инструмент для профессионала, который несет полную ответственность за итоговое решение.

Системный подход (для компаний и разработчиков): повышайте качество «пищи» для ИИ

Пользователь может влиять на запросы, а разработчик — на саму основу модели. Один из ключевых способов снизить количество галлюцинаций — это работа с данными:

- Очистка и проверка. Удаление дубликатов, противоречивых утверждений и информации из сомнительных источников из обучающих наборов.

- Обогащение достоверными данными. Добавление структурированной информации из официальных и научных источников, проверенных энциклопедий, рецензируемых журналов.

Пример: финансовый ИИ-ассистент, обученный на данных Bloomberg, SEC и официальных отчетах компаний, будет значительно точнее и надежнее того, что учился на случайных новостных статьях и форумах. Это не устраняет галлюцинации полностью, но резко сужает для них «пространство».

Для безопасной и эффективной работы с ИИ нужно выстроить рабочий процесс, где человек остается руководителем, редактором и главным контролером качества. Он задает точные задачи, проверяет результаты, отсекает вымысел и берет на себя ответственность за финальный результат.

Заключение

Галлюцинации нейросетей — это не временный «баг», который скоро исправят. Это фундаментальная особенность современных генеративных моделей, закономерный результат их работы как систем, предсказывающих вероятности, а не ищущих истину. Они будут ошибаться, выдумывать и уверенно заблуждаться — это нужно учитывать.

Количество ошибок уменьшить можно. Для корректной работы искусственному интеллекту нужны:

- качественная база данных (текстов или картинок, созданных человеком);

- задачи, соответствующие возможностям модели;

- подробные запросы и четко определенный сценарий генерации.

Также от пользователя требуются привычка тотально проверять факты и понимание, когда использовать ИИ как «умный черновик», а когда — категорически от него отказаться в пользу эксперта.

Разработчик в свою очередь несет ответственность за архитектуру: от тщательной очистки и обогащения обучающих данных до внедрения таких методов, как «заземление» (Grounding), которые насильно удерживают модель в рамках заданного контекста.

Чем выше цена ошибки, тем больше человеческого внимания нужно уделить финальному результату и тем строже должны быть технические ограничения для ИИ. Используйте нейросети для генерации идей, преодоления творческого ступора, черновой обработки данных. Но окончательный вердикт, финальная проверка и полная ответственность должны всегда оставаться за вами.

Если вас интересует, как применять новые технологии на практике — от AI-инструментов до комплексных digital-стратегий — читайте журнал Awake. Мы публикуем бизнес-кейсы, обзоры нейросетей и прогнозы от экспертов индустрии. Не пропускайте новые материалы — подписывайтесь на телеграм-канал Awake Journal, чтобы первыми получать дайджесты полезных статей для маркетологов и владельцев бизнеса.

на журнал